Meta ra mắt hàng loạt chip AI riêng

Phó Chủ tịch Kỹ thuật Yee Jiun Song cho biết các chip này giúp Meta đa dạng hóa nguồn cung silicon và phần nào giảm tác động từ biến động giá…

Mới đây, Meta công bố bốn chip tùy chỉnh do hãng tự thiết kế, phục vụ tác vụ liên quan đến trí tuệ nhân tạo, như một phần trong kế hoạch mở rộng quy mô trung tâm dữ liệu khổng lồ của công ty, theo CNBC.

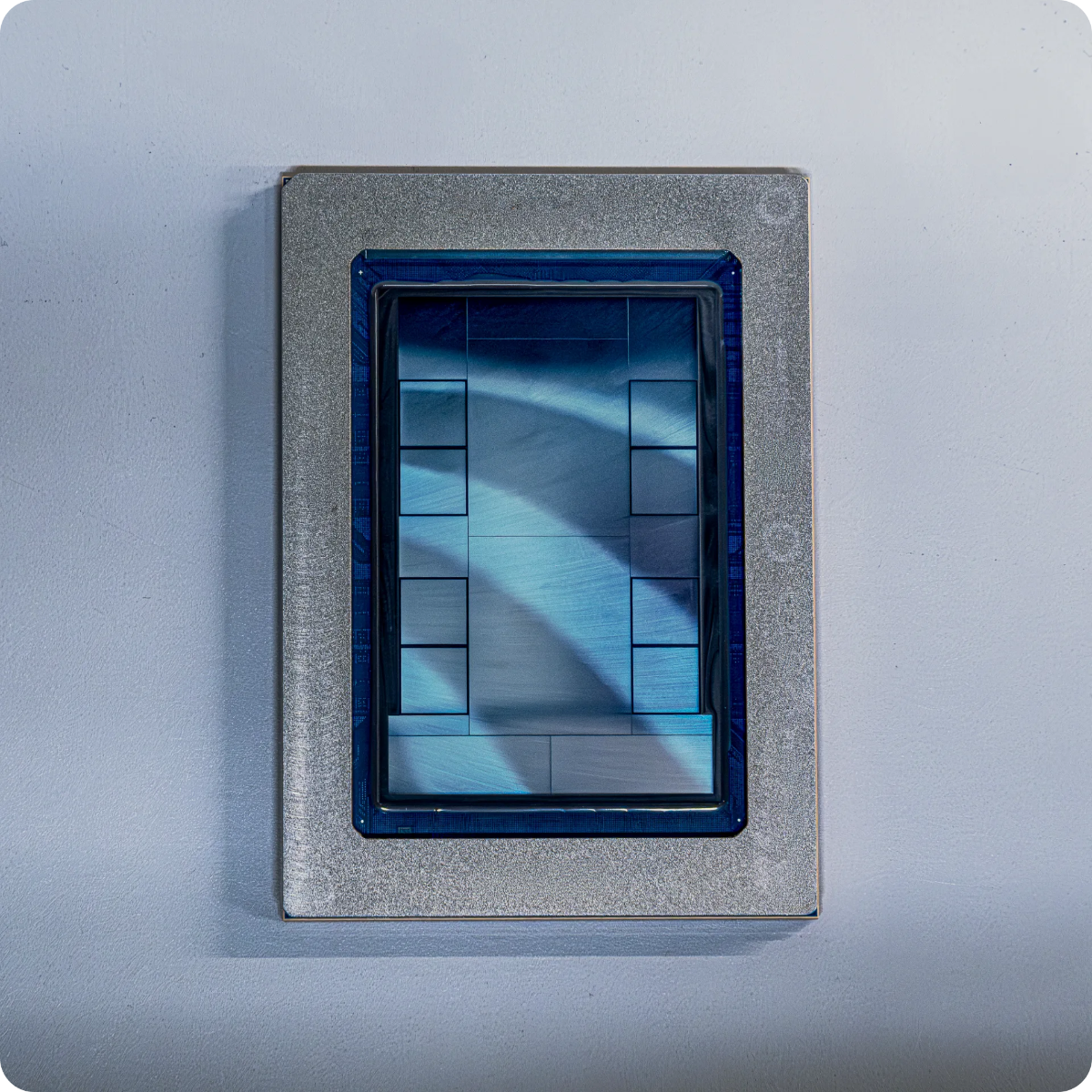

Những con chip chuyên dụng thuộc dòng Meta Training and Inference Accelerator, hay MTIA, vốn được gã khổng lồ mạng xã hội lần đầu công bố vào năm 2023 trước khi giới thiệu phiên bản thế hệ thứ hai vào năm 2024.

Phó Chủ tịch Kỹ thuật của Meta, ông Yee Jiun Song, chia sẻ với CNBC rằng bằng cách tự thiết kế chip — sau đó được sản xuất bởi Taiwan Semiconductor Manufacturing Company — Meta có thể đạt hiệu quả chi phí trên hiệu năng tốt hơn trong toàn bộ hệ thống trung tâm dữ liệu, thay vì chỉ phụ thuộc vào nhà cung cấp bên ngoài.

“Điều này cũng giúp chúng tôi đa dạng hơn về nguồn cung silicon và phần nào bảo vệ chúng tôi trước biến động về giá”, ông Song nói. “Đây cũng là đòn bẩy bổ sung”.

META TĂNG TỐC TỰ PHÁT TRIỂN CHIP AI CHO TRUNG TÂM DỮ LIỆU

Chip mới đầu tiên, MTIA 300, đã triển khai vài tuần trước và được thiết kế để hỗ trợ huấn luyện các mô hình AI nhỏ, vốn đứng sau hệ thống xếp hạng và gợi ý nội dung cốt lõi của Meta. Những tác vụ bao gồm hiển thị nội dung phù hợp và quảng cáo trực tuyến cho người dùng trên ứng dụng trong hệ sinh thái công ty như Facebook và Instagram.

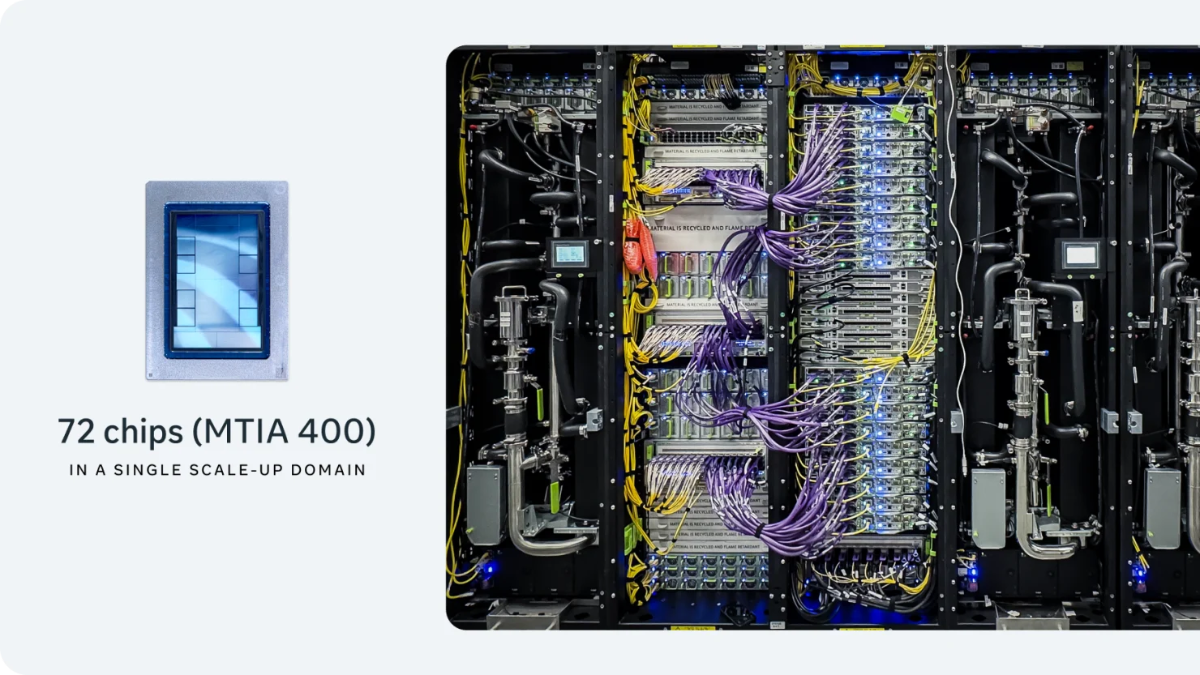

Các chip sắp ra mắt — MTIA 400, MTIA 450 và MTIA 500 — sẽ phục vụ tác vụ suy luận AI tạo sinh tiên tiến hơn, như tạo hình ảnh và video dựa trên câu lệnh văn bản của người dùng. Phó Chủ tịch Song cho biết các chip này sẽ không được dùng để huấn luyện mô hình ngôn ngữ lớn khổng lồ.

Meta nhấn mạnh trong bài đăng blog rằng đã hoàn tất thử nghiệm MTIA 400 và đang “trên lộ trình triển khai chip trong các trung tâm dữ liệu của công ty”, trong khi hai chip còn lại dự kiến đi vào hoạt động năm 2027.

CÁC ÔNG LỚN CÔNG NGHỆ CHẠY ĐUA CHIP AI RIÊNG

“Việc một công ty hoặc nhóm phát triển tung ra chip mới mỗi sáu tháng là điều khá hiếm. Đây là nhịp độ rất nhanh”, ông Song nói. “Lý do lớn là vì hiện tại chúng tôi đang mở rộng năng lực rất nhanh và chi tiêu rất nhiều cho CapEX (chi phí vốn), nên tại bất kỳ thời điểm nào chúng tôi cũng muốn sở hữu chip tiên tiến nhất để triển khai”.

Ông Song cho biết công ty kỳ vọng các chip này sẽ có “vòng đời sử dụng tiêu chuẩn hơn 5 năm”.

Chi tiêu cho AI của Meta bao gồm trung tâm dữ liệu khổng lồ tại Louisiana và hai trung tâm khác tại Ohio và Indiana. Theo Bloomberg, Meta cũng đang xem xét thuê không gian ở Texas của dự án Stargate sau khi OpenAI và Oracle hủy kế hoạch mở rộng trung tâm dữ liệu AI tại đây.

Hầu hết gã khổng lồ công nghệ như Google trong một vài năm gần đây cũng phát triển chip nội bộ phục vụ trung tâm dữ liệu, nhằm tìm kiếm giải pháp thay thế GPU AI đắt đỏ và nguồn cung hạn chế từ Nvidia hay AMD.

Những “hyperscaler” (trung tâm dữ liệu khổng lồ) đã tạo ra định nghĩa mạch tích hợp chuyên dụng theo ứng dụng, hay ASIC, vốn nhỏ hơn và rẻ hơn so với GPU AI đa dụng, nhưng chỉ thực hiện được một tập hợp nhiệm vụ hẹp.

Google là công ty đi đầu trong cuộc đua ASIC khi ra mắt Tensor Processing Unit đầu tiên vào năm 2015. Amazon theo sau với chip tùy chỉnh đầu tiên được công bố vào năm 2018. Trong khi các hãng công nghệ tích hợp chip AI tự thiết kế vào nền tảng điện toán đám mây để khách hàng sử dụng, thì chip MTIA của Meta hoàn toàn phục vụ mục đích nội bộ.

THAM VỌNG AI ĐỐI MẶT VỚI RỦI RO NGUỒN CUNG BỘ NHỚ

Các chip MTIA sắp ra mắt sẽ chứa nhiều bộ nhớ băng thông cao (HBM) để hỗ trợ tác vụ suy luận liên quan đến AI tạo sinh.

Làn sóng đầu tư AI khổng lồ của ngành công nghệ đã dẫn đến tình trạng thiếu hụt chip nhớ trên thị trường, đồng nghĩa với việc lộ trình đầy tham vọng của Meta có thể phải đối mặt với hạn chế chuỗi cung ứng trong tương lai.

“Chúng tôi có những lo ngại về nguồn cung HBM”, ông Song nói. “Nhưng chúng tôi tin rằng mình đã đảm bảo được nguồn cung cho những gì đang dự định xây dựng”.

Bộ nhớ được coi là ngành kinh doanh mang tính chu kỳ, trong đó nhà sản xuất chip thường mua loại hàng hóa này từ nhiều nhà cung cấp như Samsung, SK Hynix và Micron Technology thông qua hợp đồng ngắn hạn.

Vị Phó Chủ tịch không bình luận về việc công ty có ký các hợp đồng dài hạn hơn với nhà cung cấp bộ nhớ để tránh tình trạng thiếu hụt hay không, nhưng cho biết Meta áp dụng cách tiếp cận “đa dạng hóa” đối với chuỗi cung ứng và chiến lược silicon.

Thời gian gần đây, Meta đã ký thỏa thuận nhằm lấp đầy các trung tâm dữ liệu của hãng với hàng triệu GPU của Nvidia và lên tới 6 gigawatt GPU của AMD trong nhiều năm.

“Khối lượng công việc thay đổi rất nhanh, nên chúng tôi muốn đảm bảo rằng mình có nhiều lựa chọn”, ông Song nói khi đề cập đến loạt thỏa thuận.

Những chip nội bộ mới của Meta được sản xuất bởi Taiwan Semiconductor Manufacturing Company, công ty chủ yếu hoạt động tại Đài Loan và có một khu phức hợp sản xuất chip mới tại Arizona.

Meta từ chối bình luận về việc liệu các chip này có được sản xuất tại Arizona hay không.

Ông Song cho biết phần lớn “đội ngũ hùng hậu” gồm hàng trăm kỹ sư làm việc về chip silicon của Meta đặt tại Hoa Kỳ. Trong tổng số 30 trung tâm dữ liệu đang hoạt động và đang được lên kế hoạch của Meta, có 26 trung tâm đặt tại Hoa Kỳ.